Yapay Zekâ ve Askerî Dönüşüm...

13:55:37

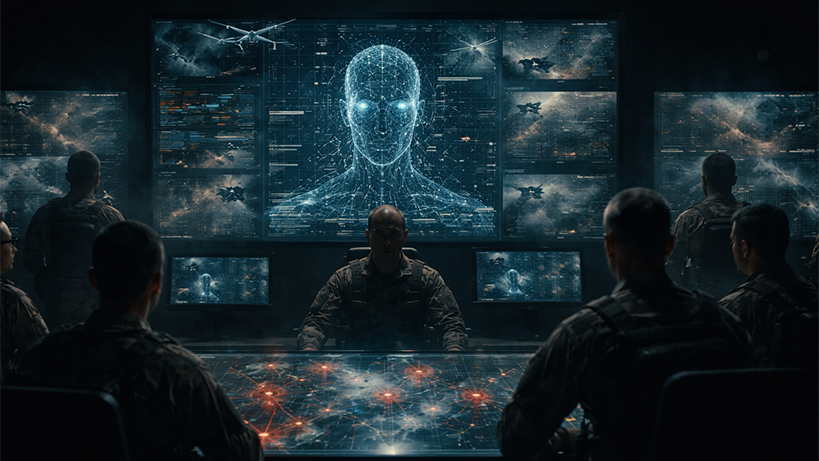

Algoritmalar Ateş Açıyor

Son dönemde ABD ve İsrail’in İran’a karşı yürüttüğü iddia edilen askerî harekâtlarda yapay zekâ destekli sistemlerin rolü, savaş teknolojilerinde niteliksel bir kırılmaya işaret etmektedir. Uzmanlar bu yeni safhayı, “düşünce hızından daha hızlı” karar üretme kapasitesine sahip algoritmik bombardıman çağı olarak tanımlamaktadır. Bu ifade abartılı görünse de, hedef tespiti ile ateş emri arasındaki zamanın dramatik biçimde kısaldığına işaret eder. Geleneksel askerî planlama döngülerinde saatler hatta günler sürebilen veri toplama, analiz ve karar aşamaları, gelişmiş makine öğrenimi modelleri sayesinde dakikalar düzeyine indirgenmektedir…

Bu çerçevede, ABD merkezli yapay zekâ şirketi Anthropic tarafından geliştirilen Claude modelinin, ABD ordusunun hedef belirleme süreçlerinde test edildiği iddiaları dikkat çekmiştir. Söz konusu modelin; insansız hava araçlarından (İHA), yüksek çözünürlüklü uydu görüntülerinden ve sinyal istihbaratından elde edilen devasa veri kümelerini gerçek zamanlıya yakın hızlarda işlediği ileri sürülmektedir. Amaç, “sensör–karar verici–atıcı” zincirini kısaltarak operasyonel çevikliği artırmaktır. Bu tür sistemler, hedeflerin önceliklendirilmesi, hareketlilik analizi ve muhtemel tehdit senaryolarının simülasyonu gibi görevlerde insan analistlere destek sağlayabilmektedir.

İddialara göre, operasyonun ilk saatlerinde yüzlerce hedefe eşzamanlı saldırı düzenlenmiş ve İran’ın komuta-kontrol altyapısı ağır baskı altına alınmıştır. Hatta İran’ın dini lideri Ali Khamenei’ye yönelik bir suikast girişiminden söz edilmiştir. Bu tür iddialar bağımsız biçimde doğrulanmamış olsa da, tartışma yapay zekânın suikast tarzı, yüksek hassasiyetli ve eşzamanlı saldırıları mümkün kılabilecek kapasiteye ulaşıp ulaşmadığı sorusu etrafında yoğunlaşmaktadır.

Newcastle Üniversitesi’nde siyasi coğrafya alanında çalışan Craig Jones gibi akademisyenler, bu dönüşümü “karar sıkıştırması” (decision compression) kavramıyla açıklamaktadır. Tarihsel olarak günler ya da haftalar süren hedef analiz döngülerinin, algoritmik veri füzyonu sayesinde neredeyse gerçek zamanlıya yaklaşması, savaşın zamansal mantığını değiştirmektedir. Özellikle Palantir Technologies’in Gotham platformu ve Anduril Industries’in Lattice sistemi gibi entegre savunma yazılımları; çoklu sensör verisini birleştirerek tehdit haritaları üretmekte, saldırı senaryolarını simüle etmekte ve operatörlere hedef önerileri sunmaktadır. Bu noktada insan rolü giderek “onaylayıcı” bir konuma indirgenmekte, anlamlı insan kontrolünün aşınması yönünde etik kaygılar artmaktadır.

ABD iç siyasetinde de bu gelişmeler tartışma yaratmıştır. Başkan Donald Trump’ın, otonom silah sistemlerinin veya iç gözetim uygulamalarının belirli sınırlar dışında kullanımına karşı çekinceler dile getirdiği; buna rağmen savunma kurumlarının farklı teknoloji şirketleriyle iş birliğini sürdürdüğü belirtilmektedir. Bu bağlamda OpenAI’ın Pentagon ile çeşitli projelerde çalıştığına dair haberler, kamuoyunda “özel sektör–askerî kompleks” ilişkisini yeniden gündeme taşımıştır.

“Operation Epic Fury” kod adıyla anılan operasyon modeli, “yazılım tanımlı savaş” yaklaşımının tipik bir örneği olarak sunulmaktadır. Bu model; yapay zekâ destekli veri sentezi, otonom tehdit adaptasyonuna sahip drone sürüleri ve gerçek zamanlı uydu koordinasyonunu tek bir dijital mimaride birleştirmeyi hedefler. Drone sürülerinin sürü zekâsı algoritmalarıyla dinamik biçimde yeniden konfigüre edilebilmesi, klasik savunma hatlarını aşma potansiyeli taşır. Ancak bu hız ve esneklik, aynı zamanda çatışma başlatma eşiğini düşürme riski barındırır. Çünkü karar alma süreci hızlandıkça, siyasi ve diplomatik fren mekanizmalarının devreye girme süresi kısalır.

Etik boyut ise en az stratejik boyut kadar önemlidir. Teknoloji ve etik alanında çalışan David Leslie gibi uzmanlar, “bilişsel yük boşaltma” (cognitive offloading) olgusuna dikkat çekmektedir. İnsan operatörler karmaşık ahlaki değerlendirmeleri algoritmalara devrettikçe, ölümcül sonuçların ahlaki ağırlığından psikolojik olarak uzaklaşabilirler. Bu durum, hesap verebilirlik zincirinde kırılmalara yol açabilir: Hedefi kim seçti? Algoritmayı kim eğitti? Yanlış istihbarat durumunda sorumluluk kime aittir? Algoritmik öldürme listeleri üretildiğinde ve insanlar yalnızca “onay” verdiğinde, hukuki ve etik sorumluluğun izini sürmek güçleşir.

Çatışmanın küresel yansımaları da dikkat çekicidir. Özellikle San Francisco gibi teknoloji merkezlerinde, yapay zekânın ölümcül operasyonlarda kullanılmasına karşı protestolar düzenlendiği bildirilmektedir. Analistler, askerî, ekonomik ve siyasi boyutları birlikte ele alan “üç saat teorisi” ile mevcut dengesizliği açıklamaktadır: Yapay zekâ askerî karar alma hızını dramatik biçimde artırırken, ekonomik yaptırımların ve siyasi istikrarsızlığın çözümü aynı hızda gerçekleşmemektedir. Sonuç olarak askerî başarı, uzun vadeli stratejik istikrarı garanti etmemektedir.

Genel tablo, yapay zekânın savaş alanında yalnızca bir araç değil, çatışmanın doğasını dönüştüren yapısal bir faktör hâline geldiğini göstermektedir. Hız, veri yoğunluğu ve otomasyon seviyesi arttıkça; etik, hukuki ve siyasi denetim mekanizmalarının da aynı ölçüde güçlendirilmesi gerekmektedir. Aksi hâlde, “düşünce hızından daha hızlı” işleyen savaş makineleri, insanlığın karar verme kapasitesini geride bırakabilir.